FOMO-Filter für KI-News im Detail

Ein Experiment mit wöchentlichen KI-Briefings hat schnell gezeigt: Die Technik ist nicht das Problem. Die Modelle sind es.

Als ich über den Filter gegen die KI-Nachrichtenflut geschrieben habe, war der wöchentliche Briefing-Agent kein Gedankenexperiment. Den hatte ich da schon am Laufen. Vier Stunden Einrichtung, ein paar Cent im Monat. Jeden Sonntagabend landet er auf meinem Handy. Vier Fragen, sauberes Layout, gefiltert durch meine tatsächliche Arbeit.

Ich nutze ihn seit Monaten. Lang genug, um zu wissen, was funktioniert, was kaputtgegangen ist, und was ich dreimal umschreiben musste, bevor der Output aufgehört hat, nutzlos zu sein.

Ein wöchentlicher KI-Briefing-Agent lässt sich mit einer einzelnen Serverless Function, einem Modell mit eingebauter Websuche und einem Push-Kanal in wenigen Stunden aufsetzen, für Betriebskosten von unter 2 Cent pro Monat. Die eigentliche Arbeit ist nicht die Technik, sondern der Prompt. Vier Iterationen waren nötig, um drei Standardfehler zu beheben: Das Modell übertrieb die Relevanz jeder Nachricht, lieferte Produkt-Updates statt Paradigmen-Shifts, und füllte leere Abschnitte mit irrelevantem Material auf, statt sie leer zu lassen.

Das hier ist keine Schritt-für-Schritt-Anleitung. Interessanter sind die Stellen, an denen das Projekt fast gescheitert wäre, bevor es brauchbar wurde.

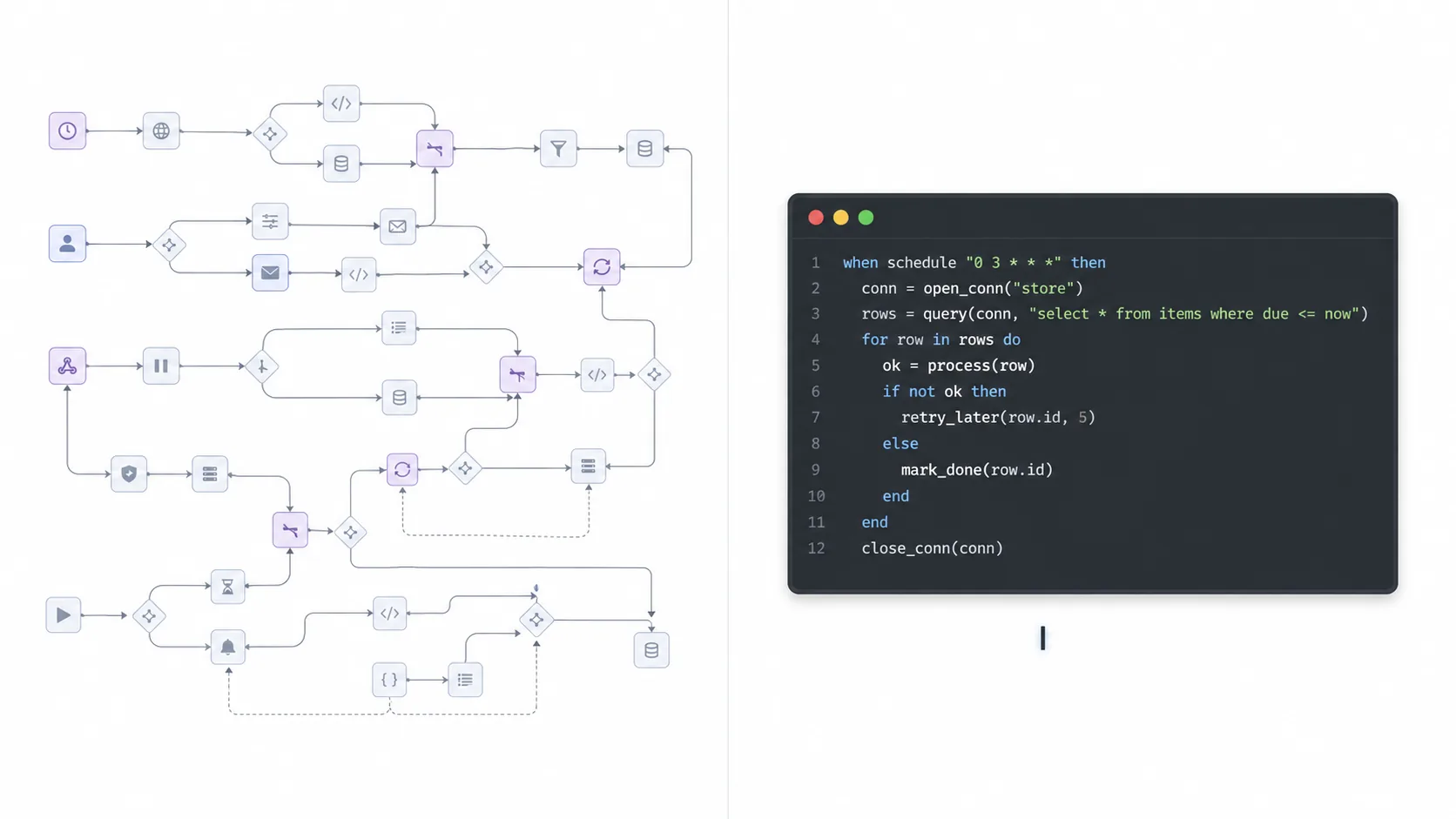

Warum es am Ende nicht n8n wurde

Im Vorgänger-Artikel hatte ich n8n vorgeschlagen. Gutes Tool, visuelle Workflows, kostenloser Einstieg. Ich habe es ausprobiert. Funktioniert. Aber für genau diesen Anwendungsfall bin ich simpler gegangen.

Eine Serverless Function. Ein API-Call an Grok über xAI's Agent Tools. Eine Push-Nachricht. Fertig.

Der Workflow braucht kein Branching und kein Dashboard. Er macht: holen, filtern, senden. Cron-Trigger, 90 Sekunden Laufzeit, Ende. Läuft auf einem Cloudflare Worker, aber jede Serverless-Plattform mit Free Tier würde funktionieren. Prompt ändern, neu deployen, drei Sekunden. Kein Klicken durch Dialoge, kein Abo.

Die Lektion: Nimm das Tool, das zur Form des Problems passt. Ein wöchentlicher Briefing-Agent ist kein Workflow. Es ist ein Script, das auf einem Timer läuft. Behandle es auch so.

Das Schwierigste ist nicht die Technik

Das hat mich überrascht. Ich hatte erwartet, dass die Integration der knifflige Teil wird. API-Anbindung, Push-Zustellung, Deployment. Das war alles an einem Nachmittag erledigt.

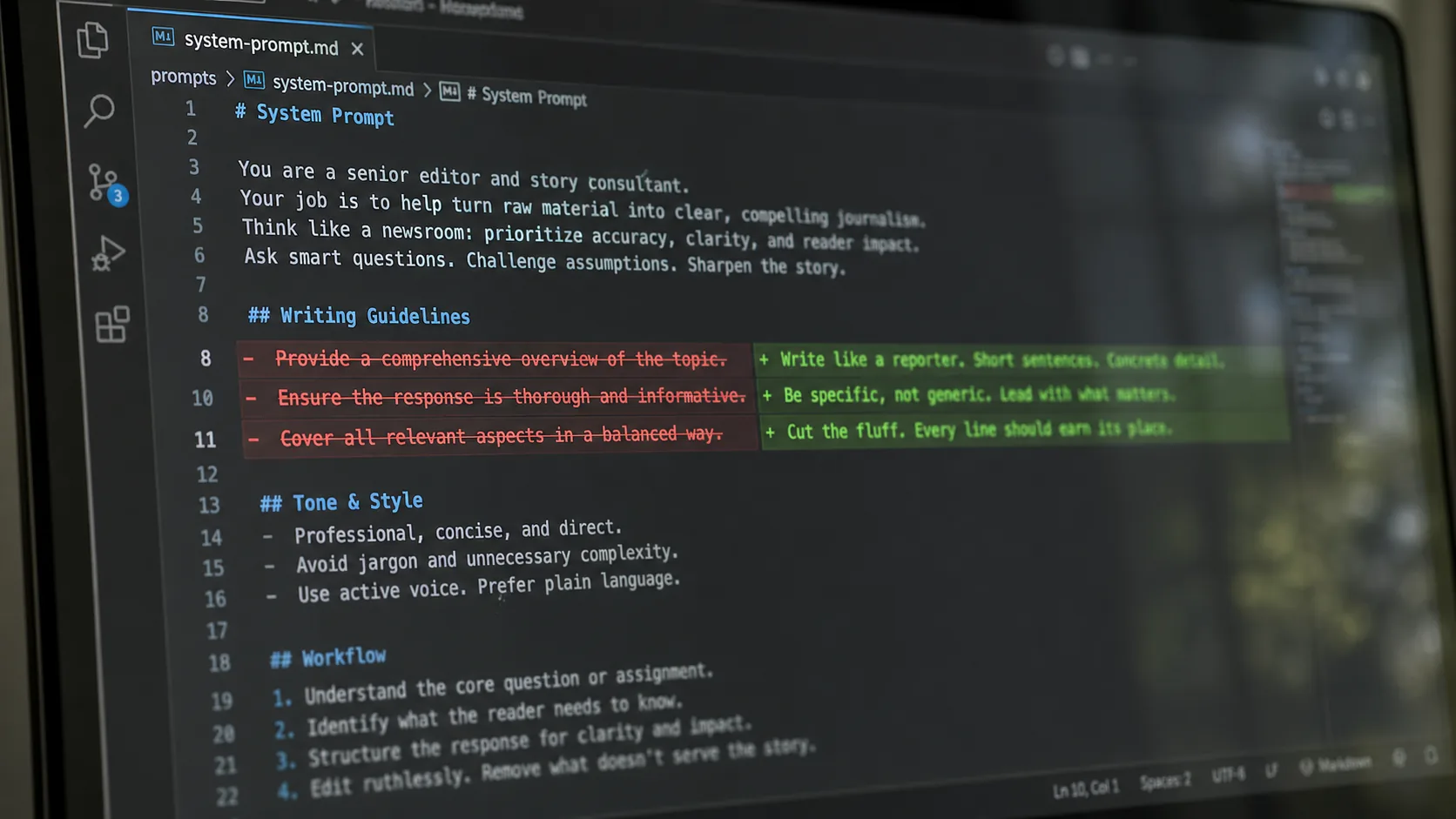

Der schwierige Teil war der Prompt. Und er blieb schwierig über vier Iterationen.

Das Modell wollte mich beeindrucken. Die ersten Durchläufe kamen mit polierten Absätzen zurück, wie revolutionär jede Veröffentlichung sei. Ich musste explizit schreiben: Schreib wie ein Reporter unter Zeitdruck. Kurze Sätze. Kein Marketing-Deutsch. Du darfst kritisch sein. Der Ton kippte von Hype zu Signal in dem Moment, als diese Anweisung drinstand.

Die Flughöhe stimmte nicht. Die erste funktionierende Version lieferte mir Produkt-Updates. „Cloudflare hat AI Search mit Storage gelauncht.“ Technisch korrekt, komplett nutzlos. Was ich wollte, war die Paradigmen-Ebene: „Cloudflare verschiebt sich von Stateless Compute zu Agent-nativer Infrastruktur.“ Gleiche zugrunde liegende Nachricht, andere Höhe. Drei Prompt-Rewrites, bis das Modell den Unterschied verstanden hat.

Es füllte Abschnitte auf, um vollständig auszusehen. Wenn es in einem Slot nichts Echtes gab, hat das Modell irgendetwas Marginales aufgeblasen, damit es reinpasst. Ich musste explizit erlauben, Abschnitte leer zu lassen. „Diese Woche nichts Relevantes“ ist ein valides Ergebnis. In den meisten Wochen bleibt mindestens ein Abschnitt leer. Das ist der Filter bei der Arbeit.

Es hat halluziniert. Zweimal. Erfundene URLs, falsche Paper-IDs. Beides Mal, weil ich den Filter zu eng geschnürt hatte. Wenn die Kriterien zu scharf waren und es kaum echte Treffer gab, hat das Modell lieber fabriziert als nichts zurückzugeben. Die Lösung war nicht „halluziniere nicht“. Modelle ignorieren diese Anweisung. Die Lösung war, die Kriterien zu lockern und die Präferenz klar zu formulieren: Zwei echte Treffer schlagen drei mit einem erfundenen.

Die eigentliche Arbeit an solchen Systemen ist fast nie die Technik. Es ist der Prompt. Und der Prompt wird erst gut durch Iteration gegen echten Output.

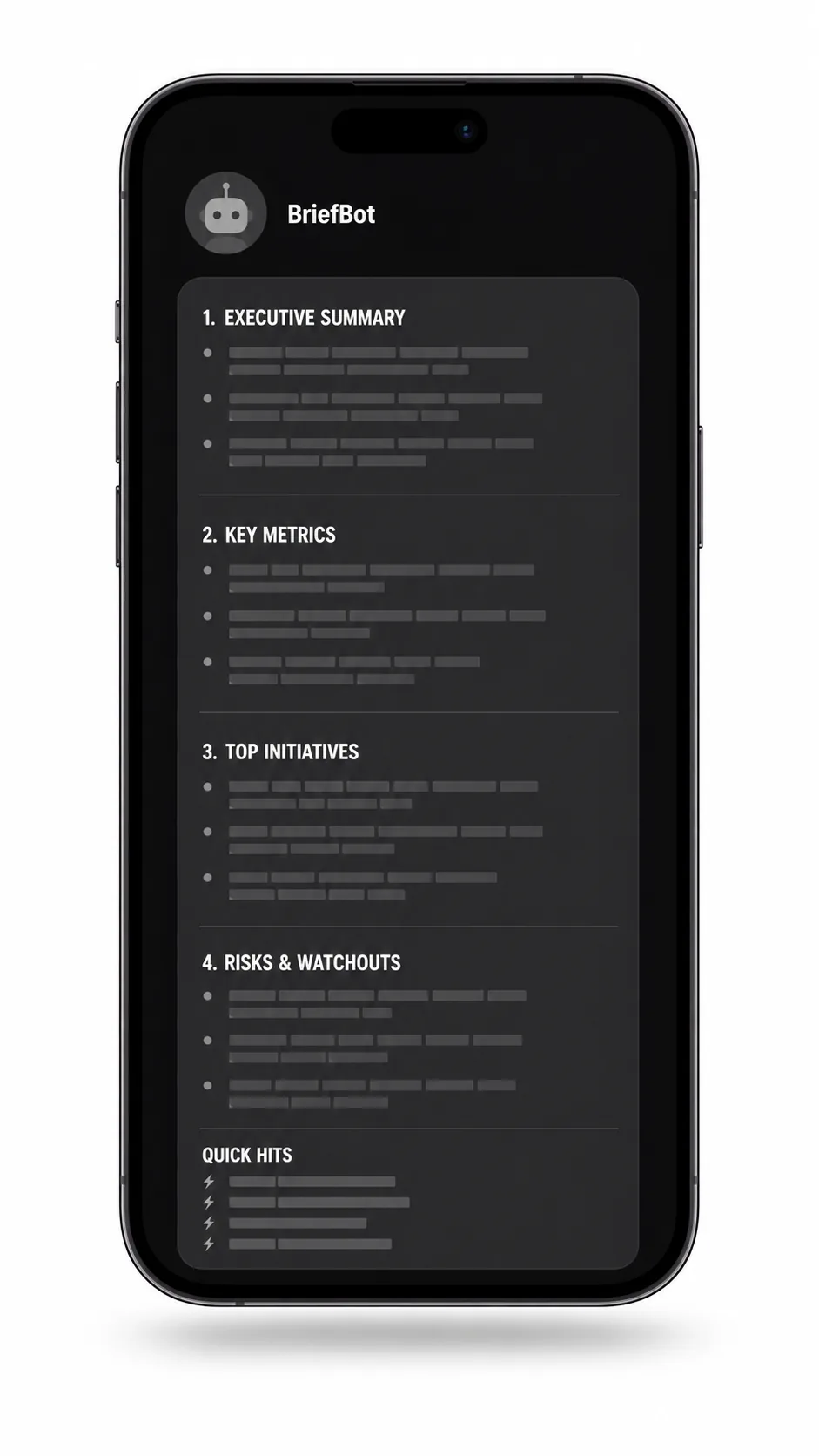

Was ich jetzt tatsächlich bekomme

Eine Nachricht auf dem Handy, jeden Sonntag, mit dieser Struktur:

- Was hat meine aktuelle Arbeit konkret verbessert? Dinge, die heute in meinen bestehenden Stack passen.

- Was ermöglicht etwas Neues? Fähigkeits-Shifts, keine Produkt-Launches.

- Was ist diese Woche Hype? Namentlich genannt, damit ich die gleichen Tweets nicht fünfmal lesen muss.

- Was teste ich 30 Minuten lang? Eine konkrete Aktion, mit Link.

Dazu ein paar Einzeiler unter „Quick Hits“ und eine einzelne Fußnote für alles außerhalb des Zeitfensters, das trotzdem führend in seinem Bereich ist.

Der Kanal zählt. Nimm den, in dem du Nachrichten reflexartig öffnest.

Kein Twitter. Keine Newsletter. Zehn Minuten lesen, vielleicht ein Link geöffnet, dann weiterarbeiten.

Was es kostet

Fast nichts. Hat mich auch überrascht.

Die Serverless Function läuft auf dem Free Tier: 100.000 Requests pro Tag inklusive, ich brauche vier im Monat. LINEs Messaging API hat ein kostenloses monatliches Kontingent, ein einzelner Push an sich selbst bleibt locker drunter. Die Hauptkosten sind der Modell-Call an Grok, plus ein kleiner Anteil für die Suchanfragen, die das Modell abfeuert, um das Web zu scannen.

Pro Durchlauf, mit etwa acht Suchanfragen über die Tools:

- Flagship Reasoning (

grok-4.20-reasoning): etwa 50.000 Tokens rein, 9.000 raus. Rund 16 Cent pro Durchlauf, also ungefähr 60 Cent im Monat bei wöchentlicher Frequenz. Täglich wären es rund 4,80 Dollar. - Fast Reasoning (

grok-4-1-fast-reasoning): etwa 12.000 rein, 4.000 raus. Unter ein halber Cent pro Durchlauf. Grob 2 Cent im Monat wöchentlich, oder 14 Cent täglich.

Ich habe beide ein paar Wochen parallel laufen lassen. Der Fast-Tier liefert etwas dünneren Output: kürzerer Meta-Abschnitt, manchmal ein Punkt weniger. Aber die Struktur hält. Der Filter funktioniert. Ein Grund dafür: Grok durchsucht X über seine eingebauten Tools, und das Quellmaterial dort ist schon dicht. Posts sind kurz, pointiert und von den Verfassern selbst komprimiert. Das Modell gräbt sich nicht durch lange Artikel. Das macht Fast Reasoning für die meisten Durchläufe ausreichend. Irgendwann habe ich aufgehört, mir über den Unterschied Gedanken zu machen, und bin beim Fast-Tier geblieben. Die zusätzliche Tiefe des Flagship-Modells rechtfertigt nicht die 36-fachen Kosten für ein wöchentliches Briefing.

Wöchentliche Updates für 2 Cent im Monat. Oder täglich einen ganzen Monat lang für 14 Cent. Da kommt keine Zeitung mit.

Was sich für mich verändert hat

Zwei Dinge.

Ich öffne Twitter nicht mehr absichtlich. Das war keine Disziplin-Maßnahme. Ich spüre den Drang einfach nicht mehr, weil ich weiß, dass der Filter alles auffängt, was relevant ist. Das FOMO ist weg, weil die Zustellung garantiert ist.

Und ich teste mehr. Filter 2 aus dem Vorgänger-Artikel, der 30-Minuten-Realitätscheck, funktioniert deutlich besser, wenn du schon einen Kandidaten parat hast. Du browsst nicht nach Tools zum Ausprobieren. Du bekommst gesagt, was du ausprobieren sollst. Die Reibung fällt auf fast null, und genau dann bleibt die Gewohnheit hängen.

Wenn du deinen eigenen aufsetzen willst

Ein paar Sachen, die dir Zeit sparen könnten:

- Halte die Pipeline einfach. Eine Function auf einer kostenlosen Serverless-Plattform reicht. Keine Datenbank, kein Dashboard. Cron-Trigger, API-Call, Push.

- Wähle einen Kanal, den du tatsächlich checkst. Nicht den, der professionell wirkt. Den, in dem du Nachrichten reflexartig öffnest.

- Iteriere den Prompt gegen echten Output. Speichere jeden Durchlauf als Datei, vergleiche die Diffs über die Iterationen. Der Prompt sieht bei den ersten drei Versuchen miserabel aus. Ab Iteration fünf hast du etwas, dem du vertraust.

- Lass Abschnitte leer. Das ist das stärkste Qualitätssignal. Wenn das System nie irgendwo „diese Woche nichts“ meldet, ist dein Filter kaputt. Dann wird aufgefüllt statt gefiltert.

- Starte täglich, dann wechsle auf wöchentlich. Täglich gibt dir sieben Datenpunkte in sieben Tagen statt einem. Iteriere schnell am Prompt gegen echte Daten, dann pendle dich auf den wöchentlichen Rhythmus ein.

- Nimm ein Modell mit eingebauter Suche. Das Web scannen und Primärquellen finden, das soll das Modell übernehmen. Grok's Agent Tools, OpenAI's Responses API mit Web Search, was auch immer du bevorzugst. Lass das Modell seinen Job machen, statt RSS-Feeds selbst zusammenzustellen.

Das ist das ganze Ding. Ein kleines Stück Software und ein sorgfältig geschliffener Prompt. Eine Nachricht pro Woche.

Es kommen nicht weniger Neuigkeiten. Ich schaue nur seltener hin. Genau das war das Ziel.