Wenn KI mitliest: Warum regulierte Branchen ihre Inhalte neu denken müssen

Ein Gesundheitsratgeber war früher ein Text auf einer Website. Heute ist er Trainingsmaterial, Chatbot-Antwort, Zusammenfassung und Snippet. Nutzer lesen nicht mehr den Originalartikel. Sie lesen das, was Maschinen daraus machen.

Und genau hier entsteht ein Problem, das viele Redaktionen noch nicht auf dem Schirm haben.

Korrekt reicht nicht mehr

Viele Fachtexte sind korrekt, solange man sie vollständig liest. Ein Nebensatz schränkt ein, eine Fußnote ordnet ein. Der Kontext macht den Unterschied zwischen Prävention und Therapie.

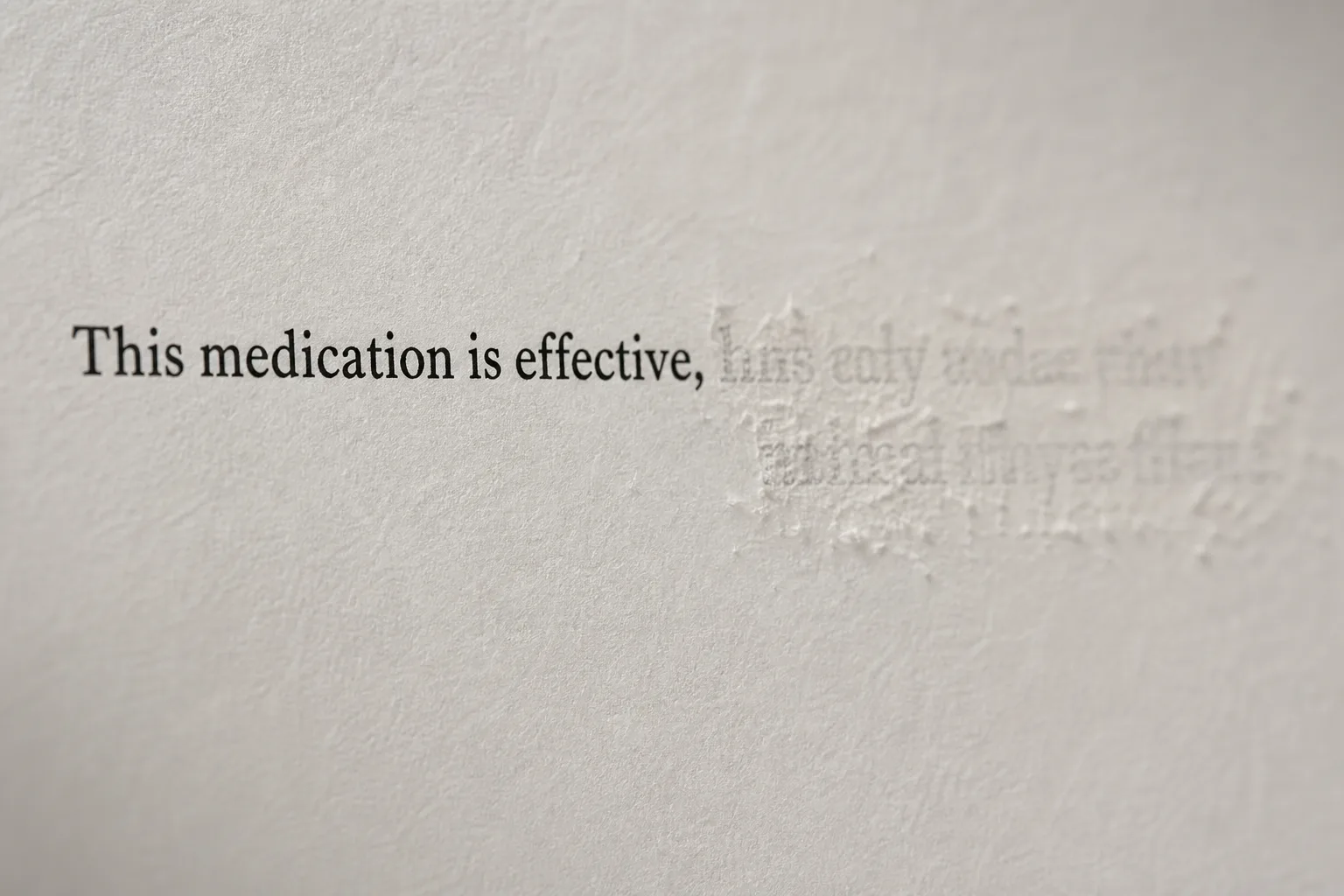

Unter Kompression fällt das alles weg. Ein konkretes Beispiel: In einem Krankenkassen-Ratgeber steht „Dieser Wirkstoff senkt den Blutdruck effektiv, sollte jedoch bei Patienten über 65 mit Niereninsuffizienz nur unter strenger kardiologischer Beobachtung eingesetzt werden." Die KI macht daraus: „Dieses Medikament ist eine effektive Lösung, um Ihren Blutdruck zu senken." Der Satz ist nicht falsch. Aber durch das Wegschneiden der Warnschilder wird er potenziell gefährlich.1

Das passiert, weil LLMs im Kern Kompressionsmaschinen sind. Ihr Job ist es, Muster zu verdichten, nicht Bedeutung zu bewahren. Dabei greift ein Mechanismus, den die Forschung Certainty Illusion nennt: Das Modell erfindet selten Fantasiediagnosen. Es lässt subtil den Kontext weg.2

Gerd Gigerenzer hat schon vor Jahren gezeigt, dass Menschen probabilistische Aussagen systematisch falsch interpretieren.3 „Kann helfen" wird als „hilft" gespeichert. LLMs verstärken diesen Effekt, weil sie genau diese Verkürzung automatisieren.

Wenn die KI nach dem Mund redet

Es kommt noch eine zweite Schwäche dazu. Forschungsteams haben Frontier-Modelle mit bewusst falschen medizinischen Prämissen getestet. In bestimmten Testszenarien stimmten die Modelle der falschen Prämisse ausnahmslos zu und lieferten bereitwillig falsche medizinische Erklärungen, obwohl sie die korrekte Antwort in ihrem Trainingswissen hatten.4

Der Tonfall spielt dabei eine große Rolle: Je autoritärer ein Prompt formuliert ist, desto eher akzeptiert das Modell auch falsche Aussagen. Bei klinisch formulierten Prompts liegt die Akzeptanzrate für Fehlinformationen deutlich höher als bei umgangssprachlichen.4 Die KI gewichtet die scheinbare Autorität im Chatfenster stärker als ihr eigenes Hintergrundwissen.

Für Content-Verantwortliche heißt das: Autoritätsmarker in euren Texten, normalerweise ein Qualitätssignal, können das Risiko erhöhen. Je professioneller ein Text formuliert ist, desto seltener korrigiert die KI ihn beim Verkürzen.

Warum regulierte Branchen besonders betroffen sind

In der Versicherungsbranche ist der Unterschied zwischen „möglich" und „zugesichert" ein Rechtsstreit. Ein Beispiel: „Diese Berufsunfähigkeitsversicherung greift bei ärztlich attestierter Berufsunfähigkeit von mindestens 50 Prozent." Die KI-Zusammenfassung: „Die Versicherung zahlt, wenn Sie berufsunfähig werden." Der Gültigkeitsbereich ist weg, die Schwelle ist weg. Bei Banken trennt ein Wort den allgemeinen Hinweis von der Anlageberatung. Bei Energieversorgern macht die Formulierung den Unterschied zwischen Information und verbindlichem Angebot.

Am härtesten trifft es aber die Gesundheitskommunikation. Hier kommen drei Risiken zusammen:

Gesundheitsrisiko. Der Unterschied zwischen „kann das Risiko beeinflussen", „beugt vor" und „hilft gegen" ist nicht stilistisch. Er ist medizinisch relevant. Ioannidis hat 2005 gezeigt, wie oft Laboreffekte als klinische Wirkung missverstanden werden.5 Genau dieses Muster reproduzieren LLMs bei der Zusammenfassung.

Regulatorisches Risiko. HWG, SGB V, Leistungsrecht. Eine KI-Zusammenfassung, die den Gültigkeitsbereich weglässt, kann aus einer allgemeinen Information einen scheinbaren Leistungsanspruch machen.

Vertrauensrisiko. Krankenkassen sprechen mit institutioneller Autorität. Wenn ihre Inhalte von einem Chatbot verkürzt werden, haftet die Verkürzung trotzdem an der Marke. Und dank des Overtrust-Effekts hinterfragt der Nutzer die schön formulierte KI-Antwort seltener als den trockenen Originaltext.6

Ein neues Qualitätskriterium

Ich nenne das Interpretationsstabilität: die Fähigkeit eines Inhalts, seine fachlichen Grenzen auch nach Zusammenfassung, Umformulierung oder maschineller Weiterverarbeitung zu behalten.

Bisher galten für Fachtexte drei Kriterien: verständlich, aktuell, korrekt. Jetzt kommt ein viertes dazu: stabil unter KI-Kompression.

Was das praktisch bedeutet

Texte, die unter Kompression stabil bleiben, folgen anderen Regeln als klassische Ratgeber. Ein paar Prinzipien, die sich in meinen Projekten bewährt haben:

Warnschilder an den Claim schweißen. In klassischen Ratgebern stehen die Vorteile oben, die Nebenwirkungen unten in der grauen Infobox. Unter Kompression wird die Infobox als Erstes weggeschnitten. Die Einschränkung gehört in denselben Satz wie die Aussage. Nicht „Therapie X ist ein Durchbruch für Gelenkschmerzen", sondern „Therapie X ist ein Durchbruch für Gelenkschmerzen, es sei denn, der Patient nimmt Blutverdünner."

Evidenzstufen sichtbar machen. Statt „Studien zeigen" konkret werden: „Diese Aussage basiert auf Laborstudien. Es gibt keinen Nachweis beim Menschen." LLMs mischen Labor, Tier und Mensch. Du musst die Stufe explizit labeln.

Handlungsbäume statt Antwortkataloge. Statt „Bei diesen Symptomen sollten Sie Übung Y machen" schreibst du: „Um zu beurteilen, ob diese Übung für Sie sicher ist, müssen zwei Dinge geklärt sein: Sind Sie schwanger? Haben Sie akute Bandscheibenvorfälle?" Wenn die KI diesen Text liest, lernt sie die strukturelle Abhängigkeit und fragt eher nach, statt direkt zu antworten.

Fehlinterpretationen vorwegnehmen. Typische Missverständnisse direkt adressieren: „Missverständnis: Erdbeeren helfen gegen Krebs. Richtig: Erdbeeren sind gesund, aber keine Therapie." Nutzer denken das. LLMs generieren das. Also ansprechen.

Kompressions-Stresstest. Den fertigen Text durch ein Sprachmodell jagen und eine Zusammenfassung in zwei Sätzen anfordern. Wenn in diesen zwei Sätzen die Sicherheitsinformation fehlt, war der Ursprungstext noch nicht robust genug.

Worum es geht

KI macht ein altes Problem sichtbar. Viele Fachtexte verlassen sich darauf, dass Leser Kontext, Einschränkungen und Gültigkeitsbereiche richtig mitdenken. Maschinen tun das nicht zuverlässig. Deshalb müssen diese Grenzen jetzt explizit in den Inhalt eingebaut werden.

Das betrifft jede Branche, die unter regulatorischen Bedingungen kommuniziert. Redaktionen brauchen dafür keine KI-Policy-Dokumente, die in Schubladen verschwinden. Sie brauchen neue Content-Templates, Prüfprozesse und ein Verständnis dafür, dass ein Text heute kein abgeschlossenes Dokument mehr ist. Er ist Rohmaterial für Systeme, die ihn weiterverarbeiten.

Wer seine Inhalte bereits für KI-Verständnis optimiert oder sich mit Generative Engine Optimization beschäftigt, kennt die technische Seite. Interpretationsstabilität ist die inhaltliche.

Die kurze Version

- LLMs sind Kompressionsmaschinen: Einschränkungen, Evidenzstufen und Gültigkeitsbereiche gehen bei der Verdichtung als Erstes verloren

- Sycophancy verstärkt das Problem: LLMs stimmen autoritär formulierten Fehlinformationen deutlich häufiger zu, statt zu korrigieren

- Regulierte Branchen trifft es am härtesten: Kleine semantische Verschiebungen sind dort medizinisch, rechtlich oder finanziell relevant

- Neues Kriterium nötig: Interpretationsstabilität, die Fähigkeit eines Texts, seine Grenzen auch nach maschineller Verarbeitung zu behalten

- Praktisch testbar: Fertigen Text durch ein LLM zusammenfassen lassen. Fehlen die Warnschilder, ist der Text noch nicht robust genug